작동 방식

- W&B Run을 생성합니다.

- 학습률이나 모델 유형 같은 하이퍼파라미터 딕셔너리를 설정(

wandb.Run.config)에 저장합니다. - 정확도와 손실 같은 메트릭을 트레이닝 루프에서 시간의 흐름에 따라 로깅합니다(

wandb.Run.log()). - 모델 가중치나 예측 테이블 같은 run 출력물을 저장합니다.

시작하기

- 데이터셋 artifact를 생성, 추적, 사용하는 데 활용할 수 있는 W&B Python SDK command를 단계별로 설명한 W&B 퀵스타트를 읽어보세요.

- 이 장에서 다음 방법을 알아보세요:

- 실험 생성

- Experiments 설정

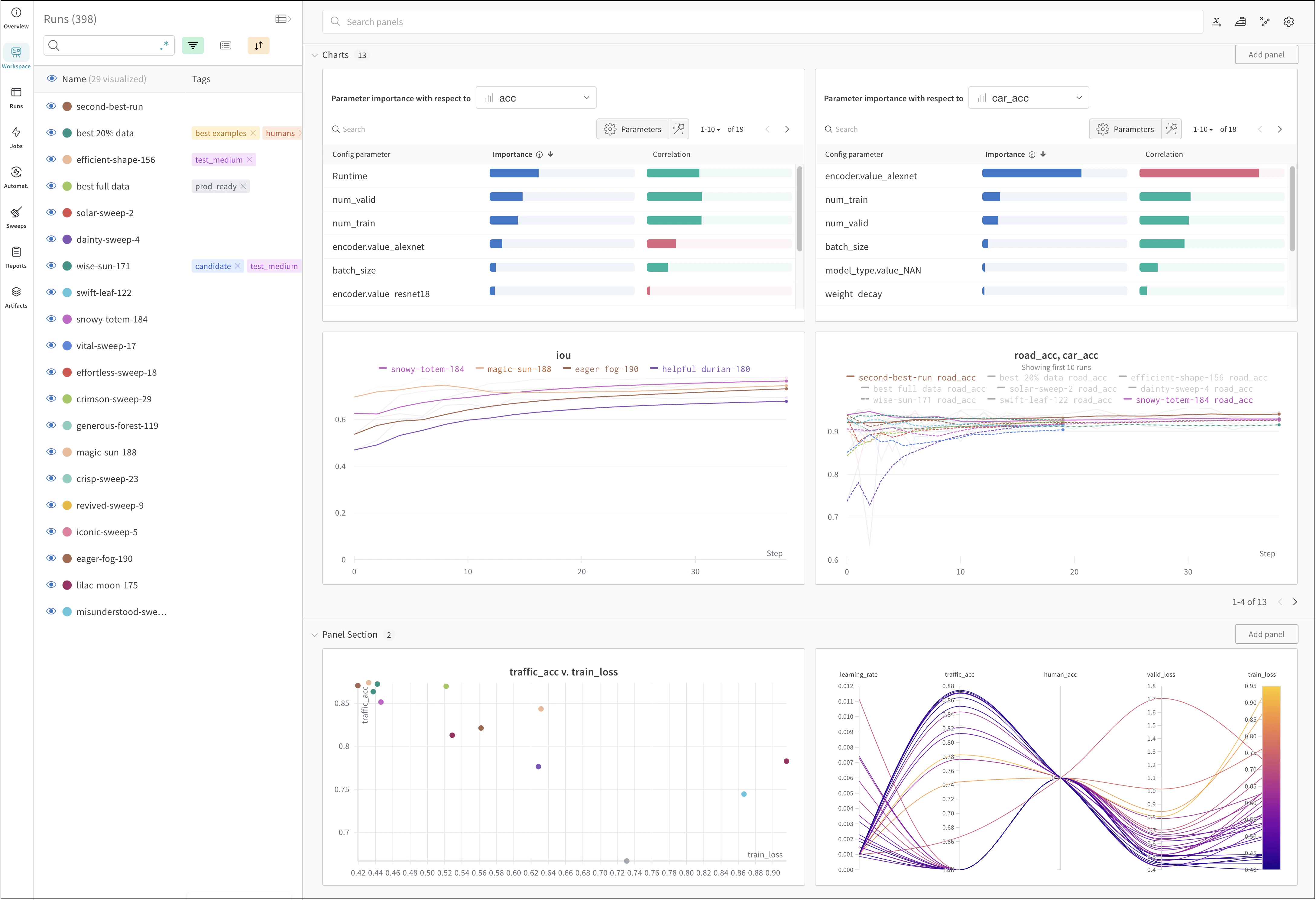

- Experiments의 데이터 로깅

- Experiments 결과 보기

- W&B API 레퍼런스 가이드의 W&B Python Library를 살펴보세요.