- 빠른 액세스: 새 세션을 시작하려면 Weave 사이드바 메뉴에서 ‘플레이그라운드’를 열고, 기존 프로젝트를 테스트하려면 Call 페이지에서 엽니다.

- 메시지 제어: 채팅 내에서 직접 메시지를 편집, 재시도, 또는 삭제합니다.

- 유연한 메시징: 새 메시지를 사용자 입력 또는 시스템 입력으로 추가해 LLM으로 보냅니다.

- 사용자 지정 가능한 설정: 선호하는 LLM 프로바이더를 구성하고 모델 설정을 조정합니다.

- 다중 LLM 지원: 팀 단위 API 키 관리와 함께 모델 간 전환이 가능합니다.

- 모델 비교: 서로 다른 모델이 프롬프트에 어떻게 응답하는지 비교합니다.

- 사용자 정의 프로바이더: 맞춤형 모델용 OpenAI 호환 API endpoint를 테스트합니다.

- 저장된 모델: 워크플로에 사용할 수 있는 재사용 가능한 모델 프리셋을 생성하고 구성합니다

프로바이더 자격 증명 및 정보 추가

- Amazon Bedrock:

AWS_ACCESS_KEY_IDAWS_SECRET_ACCESS_KEYAWS_REGION_NAME

- Anthropic:

ANTHROPIC_API_KEY - Azure:

AZURE_API_KEYAZURE_API_BASEAZURE_API_VERSION

- Deepseek:

DEEPSEEK_API_KEY - Google:

GEMINI_API_KEY - Groq:

GROQ_API_KEY - Mistral:

MISTRAL_API_KEY - OpenAI:

OPENAI_API_KEY - X.AI:

XAI_API_KEY

플레이그라운드에 액세스하기

- 간단한 시스템 프롬프트로 새 플레이그라운드 페이지 열기: Weave 프로젝트의 사이드바에서 플레이그라운드를 선택합니다. 플레이그라운드가 같은 탭에서 열립니다.

- 특정 call에 대한 플레이그라운드 열기:

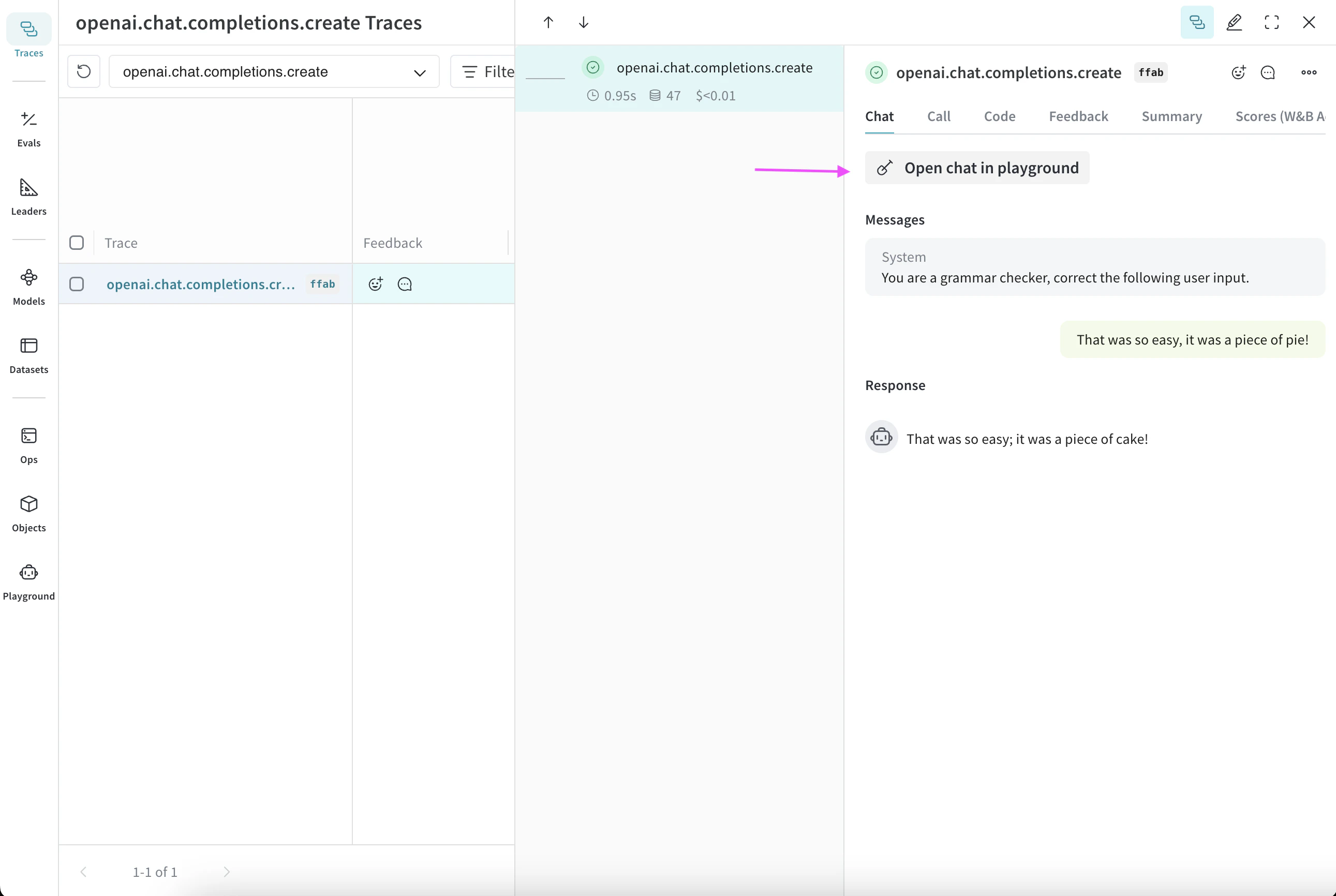

- 사이드바에서 Traces 탭을 선택합니다. 트레이스 목록이 표시됩니다.

- 트레이스 목록에서 보려는 call의 이름을 클릭합니다. call의 상세 페이지가 열립니다.

- Open chat in Playground를 클릭합니다. 플레이그라운드가 새 탭에서 열립니다.

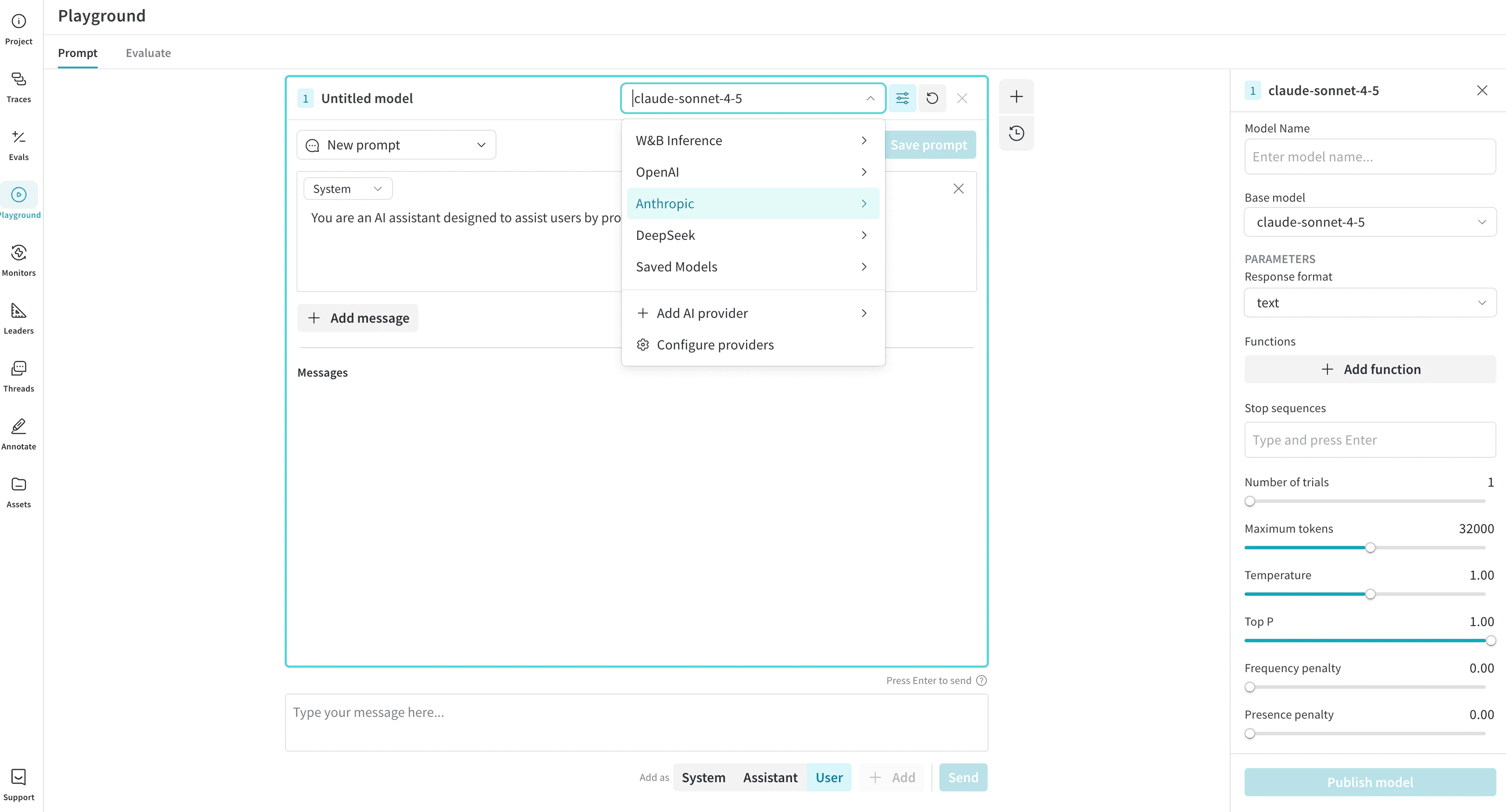

LLM 선택

- Amazon Bedrock

- Anthropic

- Azure

- Deepseek

- Groq

- Mistral

- OpenAI

- X.AI

플레이그라운드 설정 사용자 지정하기

LLM 파라미터 조정

- 프롬프트 헤더(메인 패널 상단)에서 채팅 설정 () 버튼을 클릭해 채팅 설정 패널을 엽니다.

- 채팅 설정 패널에서 원하는 대로 파라미터를 조정합니다. Weave call 추적을 켜거나 끌 수도 있고, 함수를 추가할 수도 있습니다.

- 변경 사항은 자동으로 적용됩니다. 패널을 닫으려면 채팅 설정를 다시 클릭하거나 오른쪽 상단의 x를 클릭합니다. 채팅 설정 버튼에 마우스를 올리면 표시되는 텍스트도 업데이트되어 변경한 설정이 표시됩니다.

1입니다. 시행 횟수를 조정하려면 채팅 설정 패널을 열고 Number of trials 설정을 조정하세요.

함수 추가

메시지 제어

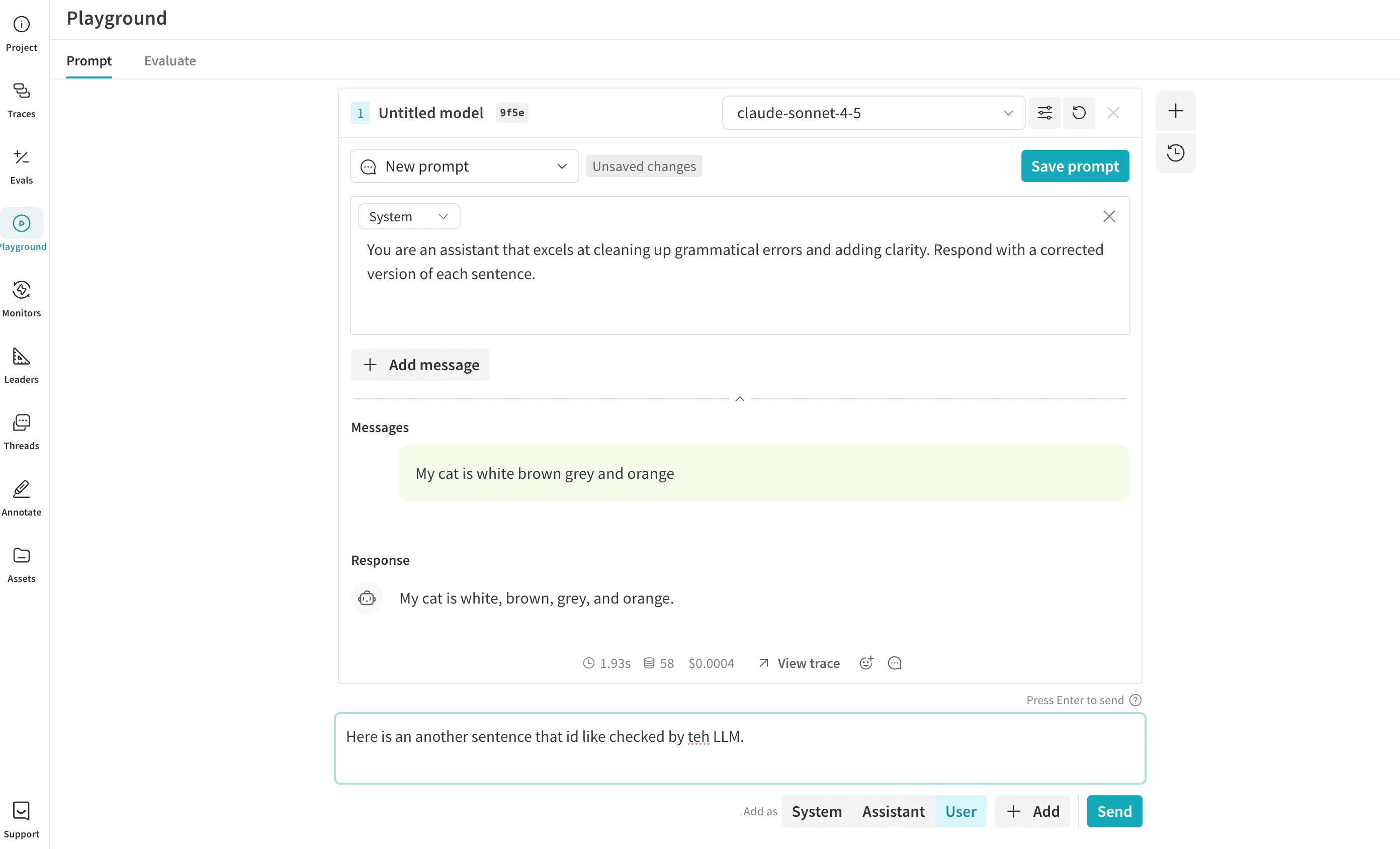

프롬프트 정의 영역

- 프롬프트 선택기: 기존에 저장된 프롬프트를 선택하거나 새로 만듭니다.

- 메시지 역할 선택기: 현재 정의 중인 메시지의 역할(System, Assistant, 또는 User 역할)을 지정합니다.

- 프롬프트 텍스트: 모델이 어떻게 응답할지 결정하는 지침 텍스트를 입력합니다.

- 메시지 추가 버튼: 실행 전에 프롬프트 컨텍스트에 추가 메시지를 포함할 수 있습니다.

- 추가 시스템 수준 지침을 더합니다.

- 응답을 유도하기 위한 Assistant 메시지 예시를 제공합니다(예: few-shot 프롬프팅).

- 특정 시나리오를 테스트하기 위한 사용자 메시지를 미리 정의합니다.

메시지 패널

- 프롬프트 설정에 포함된 미리 정의된 메시지

- 메시지 작성기에서 전송된 메시지

- 모델이 반환한 응답

메시지 작성기(입력 필드)

메시지 이력 보기

LLM 비교

사용자 정의 프로바이더

사용자 정의 프로바이더 추가

- 지원되는 모델 프로바이더의 이전 버전

- 로컬 모델

- 프롬프트 헤더(메인 패널 상단)에서 모델 선택 드롭다운을 클릭합니다.

- + Add AI provider를 선택합니다.

- Custom Provider를 선택합니다.

- pop-up modal에서 프로바이더 정보를 입력합니다.

- Provider name:

openai또는ollama와 같은 프로바이더 이름입니다. - API 키: OpenAI API 키와 같은 프로바이더의 API 키입니다.

- Base URL:

https://api.openai.com/v1/또는https://e452-2600-1700-45f0-3e10-2d3f-796b-d6f2-8ba7.ngrok-free.app와 같은 ngrok URL 등의 프로바이더용 기본 엔드포인트입니다. - Headers: (선택) 하나 이상의 맞춤형 HTTP 헤더 키-값 쌍입니다.

- Models:

deepseek-r1또는qwq와 같은 프로바이더용 하나 이상의 모델입니다. - Max tokens: (선택) 각 모델이 응답에서 생성할 수 있는 최대 token 수입니다.

- 프로바이더 정보를 입력한 후 Add provider를 클릭합니다.

- 모델 선택 드롭다운에서 새 프로바이더와 사용 가능한 모델을 선택합니다.

사용자 정의 프로바이더 편집

- 프롬프트 헤더에서 모델 선택 드롭다운을 클릭합니다. 그런 다음 +Configure providers를 선택합니다.

- 또는 사이드바 메뉴에서 프로젝트를 선택한 다음 AI 프로바이더 탭을 선택할 수 있습니다.

- Custom providers 테이블에서 업데이트하려는 사용자 정의 프로바이더를 찾습니다.

- 사용자 정의 프로바이더 항목의 Last Updated 열에서 편집 버튼(연필 아이콘)을 클릭합니다.

- 팝업 모달에서 프로바이더 정보를 편집합니다.

- Save를 클릭합니다.

사용자 정의 프로바이더 제거

- 프롬프트 헤더에서 모델 선택 드롭다운을 클릭한 다음 +프로바이더 구성을 선택합니다.

- 또는 사이드바 메뉴에서 프로젝트를 선택한 다음 AI 프로바이더 탭을 선택할 수 있습니다.

- 사용자 정의 프로바이더 테이블에서 삭제하려는 사용자 정의 프로바이더를 찾습니다.

- 해당 사용자 정의 프로바이더 항목의 Last Updated 열에서 삭제 버튼(휴지통 아이콘)을 클릭합니다.

- 팝업 모달에서 프로바이더를 삭제할 것인지 확인합니다. 이 작업은 되돌릴 수 없습니다.

- 삭제를 클릭합니다.

로컬 모델을 사용자 정의 프로바이더로 사용

- 사용 중인 운영 체제에 맞는 ngrok를 설치합니다.

-

Ollama 모델을 시작합니다:

-

별도의 터미널에서 필요한 CORS 헤더를 포함해 ngrok 터널을 생성합니다:

-

ngrok가 시작되면

https://xxxx-xxxx.ngrok-free.app와 같은 공개 URL이 표시됩니다. 플레이그라운드에서 사용자 정의 프로바이더를 추가할 때 이 URL을 Base URL로 사용하세요.

저장된 모델

모델 저장

- 프롬프트 헤더(메인 패널 상단)의 모델 선택 드롭다운에서 제공업체와 모델을 선택합니다.

- 프롬프트 헤더에서 채팅 설정 () 버튼을 클릭해 채팅 설정 패널을 엽니다.

- 채팅 설정 패널에서:

- 모델 이름 (필수): 저장할 모델의 이름을 입력합니다.

- 원하는 대로 매개변수를 조정합니다. Weave call 추적을 켜거나 끌 수도 있고, 함수를 추가할 수도 있습니다.

- 모델 게시를 클릭합니다. 모델이 저장되며 모델 선택 드롭다운의 저장된 모델에서 사용할 수 있습니다. 이제 저장된 모델을 사용하고 업데이트할 수 있습니다.

저장된 모델 사용

- 프롬프트 헤더의 모델 선택 드롭다운에서 저장된 모델을 선택합니다.

- 저장된 모델 목록에서 불러올 모델을 선택합니다. 모델이 로드되면 플레이그라운드에서 바로 사용할 수 있습니다.

저장된 모델 업데이트

- 프롬프트 헤더의 모델 선택 드롭다운에서 저장된 모델을 선택합니다.

- 저장된 모델 목록에서 업데이트할 저장된 모델을 선택합니다.

- 프롬프트 헤더에서 채팅 설정 () 버튼을 클릭해 채팅 설정 패널을 엽니다.

- 채팅 설정 패널에서 원하는 대로 파라미터를 조정합니다. Weave call 추적을 켜거나 끌 수도 있고, 함수를 추가할 수도 있습니다.

- 모델 업데이트를 클릭합니다. 그러면 모델이 업데이트되어 모델 선택 드롭다운의 저장된 모델에서 사용할 수 있게 됩니다. 저장된 모델의 버전은 자동으로 증가합니다.